说实话,在当下的体育科技圈,大家最怕的就是“大赛卡顿”。每当强强对话进入白热化,几百万人同时涌入平台,那种由于瞬时流量激增导致的页面转圈圈、操作无响应,简直是体验的毁灭者。

在米兰体育的技术演进中,边缘计算(Edge Computing)正从幕后走向台前。它不是什么玄学,简单说,就是为了在流量山呼海啸时,给中心服务器找一群“分身”来扛雷。

高峰期卡顿问题的本质是什么?

并发访问瞬时激增

体育赛事的魅力就在于它的“共时性”。当欧冠决赛进球或者NBA最后一分钟时,用户访问量不是线性增长,而是垂直爆发。这种短时间内集中产生的请求,对任何单中心架构都是毁灭性的冲击。

中心服务器处理压力过大

如果所有的逻辑运算、数据查询、赔率刷新都挤在一个位于远方的“主脑”里,服务器就像早高峰的地铁站台,人太多,门根本关不上。这种集中式计算造成的瓶颈,是导致米兰体育早期系统响应变慢的根本原因。

数据同步链路过长也会增加风险。请求每经过一个路由器,每跨越一次海缆,都会增加几十毫秒的延迟。在毫秒必争的体育实时交互中,这几十毫秒就是卡顿的元凶。

什么是边缘计算?核心机制解析

计算能力向用户端迁移

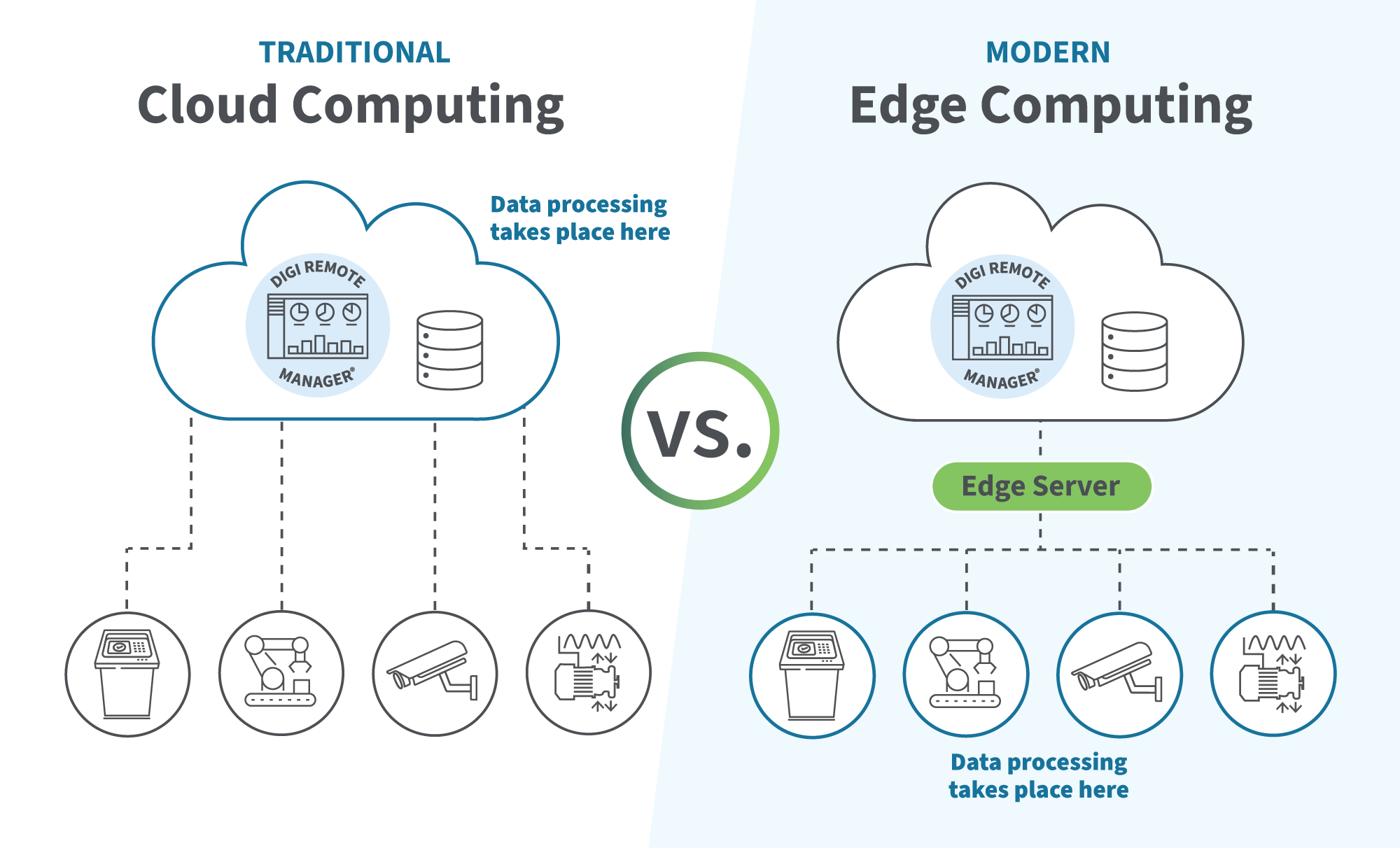

传统的“云计算”模式像是一家超大型超市,不管你在哪,都得跑去总部提货。而边缘计算则是直接在离你最近的街道开了无数个便利店。米兰体育通过在不同区域部署分布式节点,让计算任务在离你几百公里的地方就处理完了。

这种架构最爽的一点在于它大幅减少了对中心节点的依赖。大部分的基础请求和数据分发直接在边缘侧搞定。

缩短数据传输路径

物理距离决定了延迟。边缘计算通过“就近原则”,让请求和响应之间的距离缩短到极致。在米兰体育的实时系统里,这意味着你点开一个盘口或者刷新比分时,数据不用跨越半个地球去打卡。

边缘计算如何缓解高峰期卡顿?

分流是解决拥堵的唯一办法。通过边缘节点分担压力,原本涌向中心服务器的流量被切割成了几十份、上百份,分散到了各地的边缘服务器上。这就像是把一条主干道的车流引向了无数条辅路,路面宽了,自然就不堵了。

在米兰体育的测试环境中,这种结构改善非常明显。尤其是在核心服务器负载降低后,整体系统的容错率和响应速度表现得非常稳。即便是在极端的高并发情况下,延迟波动也被压制在一个极小的范围内。

米兰体育系统中的技术优化结构

米兰体育在这一块的投入,主要集中在几个“看不见”的地方:

多节点分布式部署: 建立覆盖全球主要区域的节点网,确保用户“触手可及”。

智能路由调度: 系统内部有个“老司机”,能实时感应网络拥堵。如果某条线路堵了,它会自动带你的数据走最快的小路。

动态负载均衡: 哪个节点太忙了,负载均衡系统会自动把流量分给更清闲的节点。

常见认知误区

虽然技术很猛,但咱们也得理清一些常识:

延迟无法被彻底消除: 只要有物理距离,延迟就存在。边缘计算是把延迟从“肉眼可见”优化到“无法察觉”。

用户网络仍是关键: 如果你身处的WiFi信号微弱,或者手机正在下载几个G的更新包,那再牛的边缘节点也救不了你的卡顿。

极端峰值的挑战: 即使有了边缘计算,像世界杯决赛读秒阶段这种恐怖的流量,依然是对物理极限的挑战。

总体来看,边缘计算不再是可选的插件,它是支撑米兰体育这类平台在高峰期“稳如老狗”的底层基石。通过把计算能力下沉、优化传输路径,它确实让体育交互进入了真正的丝滑时代。但要明白,高峰期体验优化是个系统工程。边缘计算是其中最硬核的那块拼图,但它还需要配合更高标准的数据协议和本地网络环境。说到底,理解了这些底层逻辑,能让你在面对高并发波动时多一份理性和从容。